Appearance

激活函数和损失函数

激活函数

- Softmax:将输出转化为概率,总和=1

- 多元分类(互斥):总和为 1,适合表达多种类别

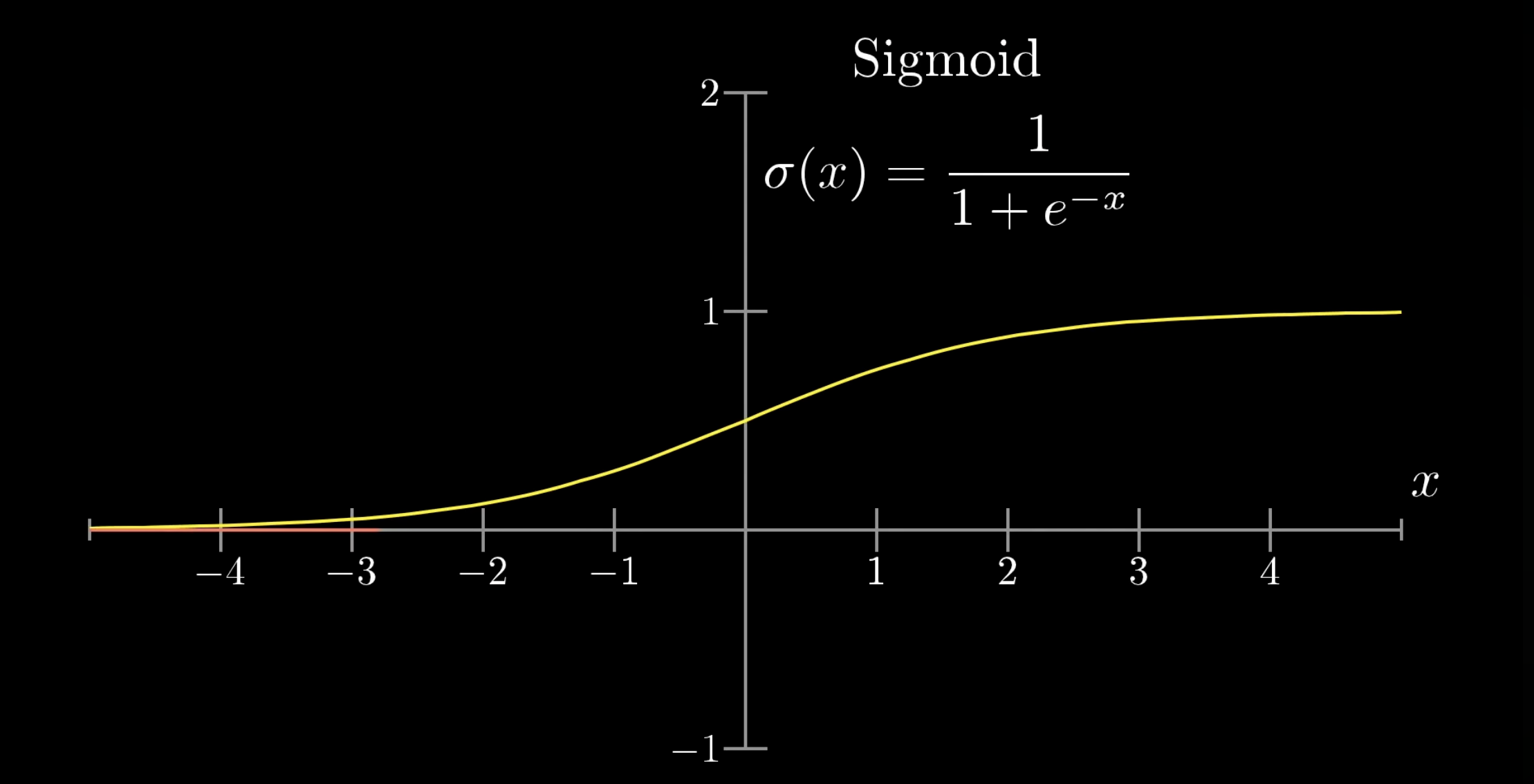

- Sigmoid:将输出转化为概率 0~1,可直接解释为“猫的概率是 0.8”

- 二元分类:大于 0.5,认为是类别 1,小于 0.5,认为是类别 2

- Tanh:类似 Sigmoid,将输出转化为概率 -1~1

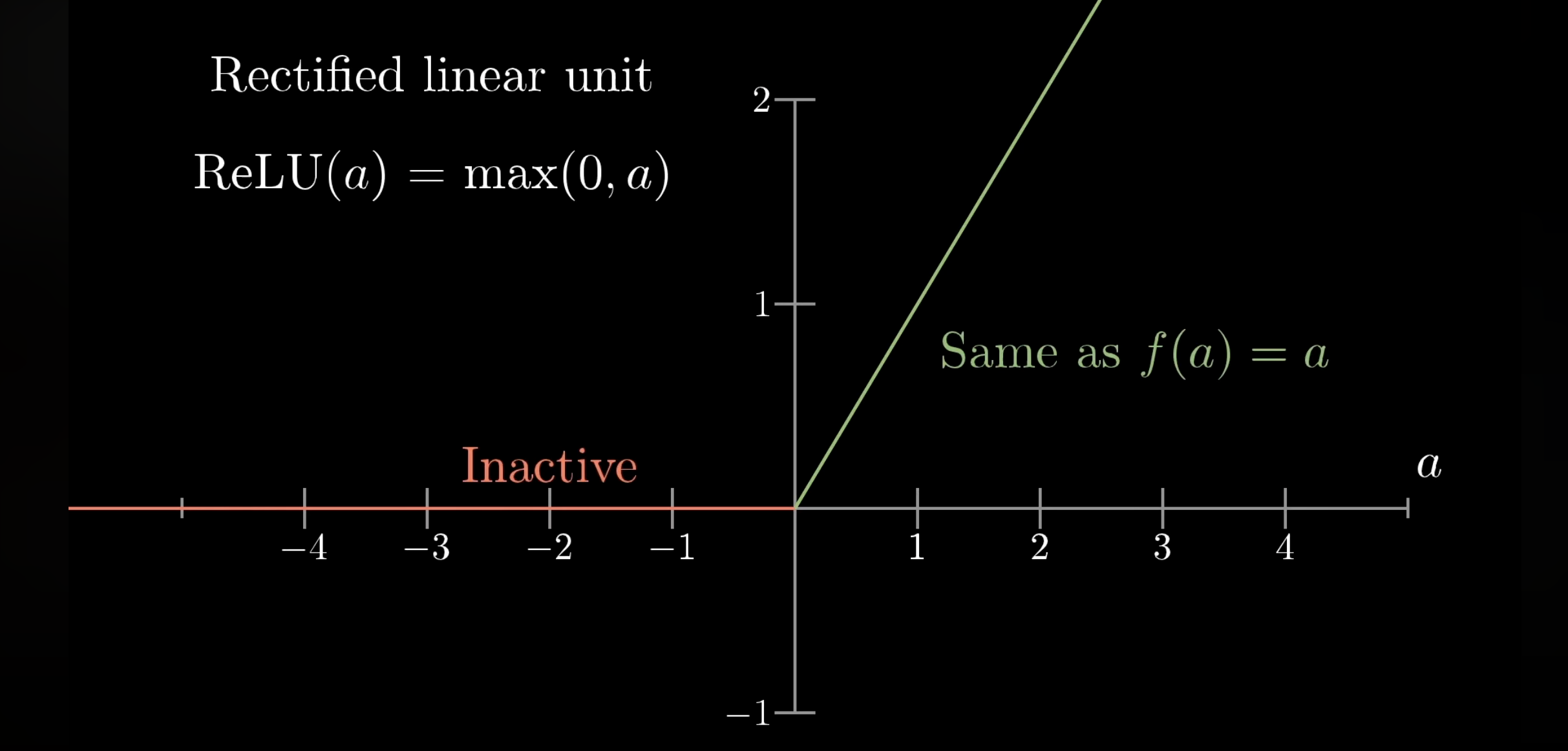

- ReLU

- CNN 隐藏层/Transformer FFN 层/MLP 隐藏层

- 回归任务:非负约束,过滤负特征,线性放大正特征,给后面层更干净的信号

Sigmoid

ReLU

损失函数

均方误差 MSE

Loss=∑(ytrue−ypred)2

- ytrue−ypred -> 预测误差(偏差)

- 平方 → 放大大的偏差,小的偏差几乎无感,同时保证损失总是正数

- 求和 → 把所有样本的误差加起来,得到整体“做得好不好”的量

这就是 均方误差(MSE, Mean Squared Error)的总和版本,常用在 回归问题里:预测连续值(房价、温度、销售量…)的损失函数。

- 预测房价:真实房价 100 万,你预测 90 万 → 偏差 10 万,平方后变 100(万 ²),更容易让模型去纠正大偏差。

- 预测温度:真实 25℃,预测 23℃ → 偏差 2,平方后 4,惩罚小一点。

- 股票预测:预测偏差大的点会被放大,模型会优先学会修正大错误。

这是回归里最经典的损失函数,用来衡量模型预测和真实值的差距,平方放大偏差,让模型尽量少出大错。

micrograd 里用到了这个损失函数

MAE

torch.nn.L1Loss()

回归任务常用这个

CrossEntropyLoss

分类任务常用这个